В минувшую пятницу, 10 ноября, международная организация «Репортеры без границ» опубликовала Парижскую хартию по искусственному интеллекту и журналистике — свод из десяти правил, призванных задать для отрасли этические рамки при работе с инструментами ИИ, определить набор базовых принципов для защиты качества новостей и информации в эпоху искусственного интеллекта. «Социальная роль журналистики заключается в том, чтобы выступать надежным посредником для общества и отдельных граждан, и это краеугольный камень демократии […]. Системы искусственного интеллекта способны в этом помочь, но только в том случае, если они используются прозрачно, справедливо и ответственно […]. Подтверждая эти принципы, мы выступаем за независимую журналистику и обязуемся предоставлять достоверные новости в эпоху ИИ», — говорится в преамбуле документа, приуроченного к стартовавшему в тот же день в Париже Форуму мира..

Группу по подготовке хартии возглавила Мария Ресса, филиппинско-американская журналистка, в 2021 году разделившая Нобелевскую премию мира с главным редактором «Новой газеты» Дмитрием Муратовым. Свои подписи под документом поставили 16 крупнейших журналистских организаций, включая Пулитцеровский центр, Глобальный форум по развитию СМИ, Европейский центр журналистики.

Создатели хартии предлагают журналистскому сообществу в том числе такие принципы:

- используя технологии, журналисты в первую очередь должны руководствоваться этикой;

- последнее слово в принятии редакционных решений должно оставаться за человеком;

- СМИ должны помогать обществу отличать аутентичный журналистский контент от созданного с помощью ИИ;

- используемые в СМИ системы искусственного интеллекта должны проходить предварительную независимую оценку;

- СМИ всегда несут ответственность за публикуемый ими контент, даже если он создан с помощью ИИ.

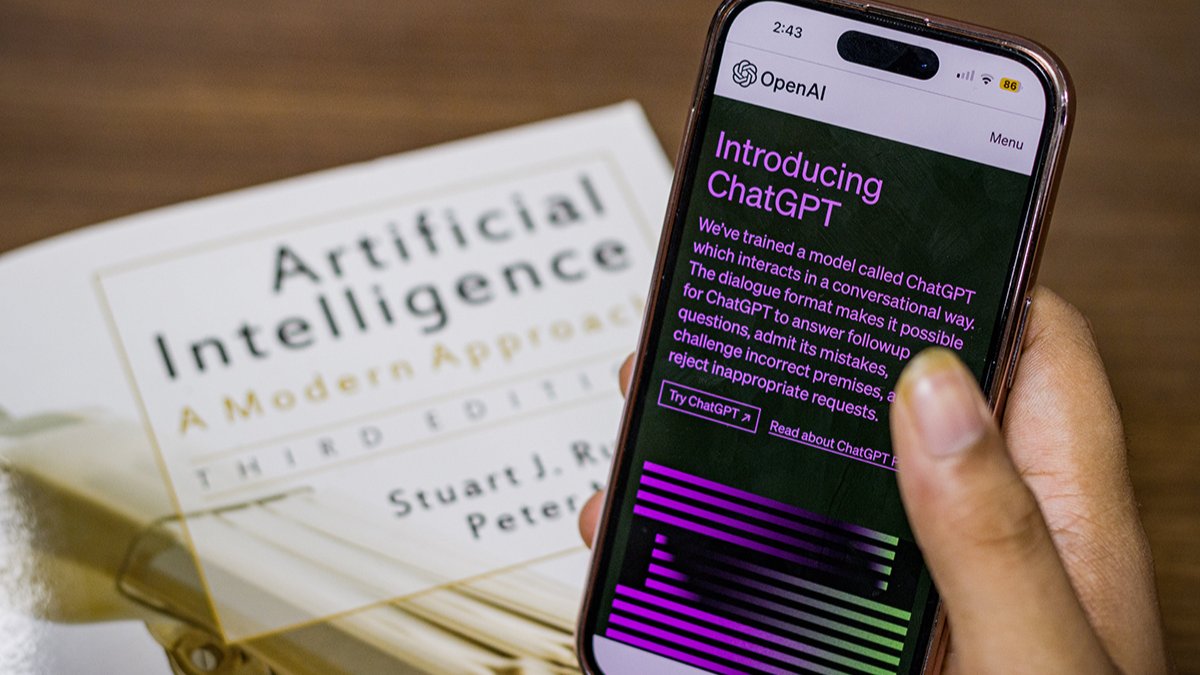

Авторы отдельно заострили внимание на том, что доступ к журналистским материалам с помощью систем ИИ должен регулироваться специальными соглашениями. Дело в том, что для совершенствования текстовых моделей ИИ, таких, как ChatGPT, используется огромный массив текстов, создатели которых зачастую не получают за это никакого вознаграждения. Запрет на использование своих материалов в качестве «сырья» для ИИ уже наложили многие крупные мировые медиахолдинги, включая The New York Times, The Guardian и CNN. Также в этом году несколько тысяч участников Гильдии авторов — крупнейшей американской писательской организации — написали открытое письмо разработчикам ИИ, в котором запретили использовать свои тексты без соответствующего вознаграждения.

«Вы тратите миллиарды долларов на разработку ИИ. Будет справедливо, если вы компенсируете нам использование наших работ»,

— говорится в письме, адресованном OpenAI, Meta, Microsoft и другим производителям инструментов искусственного интеллекта.

«Источник связан с искусственным интеллектом»

Подготовке и выпуску хартии предшествовала целая череда скандалов, связанных с неудачными попытками журналистов внедрить инструментарий ИИ в свою работу. Одним из пионеров в этой области стал американский развлекательный портал BuzzFeed, основатель которого Джона Перетти официально объявил, что издание пользуется инструментами ИИ для создания викторин. Однако журналисты издания Futurism обнаружили, что одними викторинами дело не ограничивается:

BuzzFeed использует текстовые алгоритмы для выпуска десятков статей с клишированной структурой и выстроенными будто под копирку фразами.

В конце прошлого года финансовая редакция портала CNET, одного из крупнейших ресурсов о технологиях и потребительской электронике, опубликовала 75 статей, полностью сгенерированных искусственных интеллектом, не сопроводив их специальным маркером. Попытка оптимизировать работу обернулась скандалом — коллеги по цеху быстро обнаружили в этих материалах многочисленные фактические ошибки, так что вице-президенту издания Конни Гильермо пришлось писать публичную объяснительную.

Наконец, в апреле произошел, пожалуй, самый крупный на сегодняшний день скандал, связанный с использованием искусственного интеллекта в СМИ. Немецкий журнал Die Aktuelle опубликовал полностью сгенерированное ИИ интервью автогонщика Михаэля Шумахера, уже десять лет не выходящего из комы после тяжелой черепно-мозговой травмы. Редакция намекнула, что источник интервью «связан с искусственным интеллектом», и поставила в качестве подзаголовка фразу: «Это звучало обманчиво правдоподобно». Однако семья легендарного пилота «Формулы-1» немедленно объявила, что подаст на журнал в суд, и издателю, медиагруппе Funke, пришлось уволить главного редактора Die Aktuelle, проработавшего на этой должности 14 лет.

Как отмечает генеральный секретарь «Репортеров без границ» французский издатель Кристоф Делуар, искусственный интеллект может довести манипулирование обществом до невиданных масштабов. Поэтому для работы с ним журналистскому сообществу необходимо придерживаться жестких этических принципов. Сформулировать их — задача Парижской хартии по искусственному интеллекту и журналистике.

«Вместе с нашими партнерами мы призываем репортеров, редакторов и новостные организации по всему миру взять на себя ответственность за эти принципы, провозгласить их и применять в своей деятельности», — заявил Делуар.

Напомним, что в начале ноября в Лондоне 28 стран, включая США и Китай, подписали «Декларацию Блетчли» — первое международное соглашение о признании рисков, связанных с использованием искусственного интеллекта. В документе особо подчеркиваются угрозы в сфере безопасности, биотехнологий и дезинформации и определяются способы их снижения.

Делайте «Новую» вместе с нами!

В России введена военная цензура. Независимая журналистика под запретом. В этих условиях делать расследования из России и о России становится не просто сложнее, но и опаснее. Но мы продолжаем работу, потому что знаем, что наши читатели остаются свободными людьми. «Новая газета Европа» отчитывается только перед вами и зависит только от вас. Помогите нам оставаться антидотом от диктатуры — поддержите нас деньгами.

Нажимая кнопку «Поддержать», вы соглашаетесь с правилами обработки персональных данных.

Если вы захотите отписаться от регулярного пожертвования, напишите нам на почту: [email protected]

Если вы находитесь в России или имеете российское гражданство и собираетесь посещать страну, законы запрещают вам делать пожертвования «Новой-Европа».